希望以及医学人工智能向我们的缺陷

一个病人躺在手术台上的手术团队陷入了僵局。他们找不到肠道破裂。外科医生大声问道,“检查是否我们错过了一个视图的肠道部分视觉饲料的最后15分钟。”An artificial intelligence medical assistant gets to work reviewing the patient's past scans and highlighting video streams of the procedure in real time. It alerts the team when they've skipped a step in the procedure and reads out relevant medical literature when surgeons encounter a rare anatomical phenomenon.

医生在所有学科,从人工智能与援助,可能很快就有能力迅速查阅病人的整个医疗文件的背景下所有医疗卫生保健数据和每一个在线出版的医学文献。这种潜在的多功能性在医生的办公室直到现在可能由于最新一代的人工智能模型。

“我们看到了一个范式转变医学人工智能领域的“法律上Leskovec说,斯坦福大学计算机科学教授工程。“以前,医学人工智能模型只能处理非常小,狭窄的卫生保健问题的任务。现在我们正在进入一个新的时代,更大块的难题在这个高风险领域。”

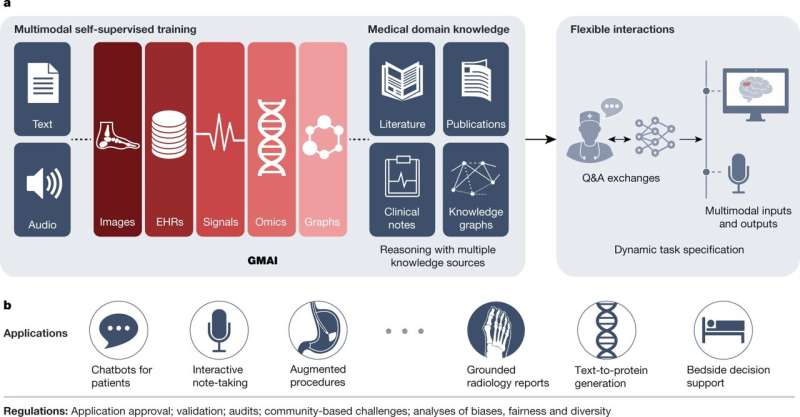

斯坦福大学研究人员和他们的合作者描述多面手医学人工智能或GMAI,作为一种新的医学人工智能模型,知识渊博的,灵活的和可重用的许多医疗应用程序和数据类型。他们的观点在这提前发表在4月12日出版的自然。

Leskovec和他的合作者编年史GMAI将如何解释不同组合的数据成像,电子健康记录、实验室结果、基因组学和医学文本超出像ChatGPT并发模型的能力。这些GMAI模型将提供口头解释,提供建议,画草图,标注图像。

“许多效率低下和错误发生在医学超专业化的今天发生因为人类医生和缓慢和参差不齐的信息流动,“co-first作者迈克尔•摩尔人说现在医学博士和博士后学者在斯坦福大学工程。“通才医学人工智能模型的潜在影响可能是深远的,因为他们不会只是一个专家在自己的狭小的区域,但会有更多的跨专业的能力。”

医学无国界

超过500的人工智能模型的临床医学获得FDA批准,大多数只执行一个或两个狭窄的任务,如扫描x射线胸透肺炎的迹象。但是最近的地基模型研究进展承诺解决更加多样化和具有挑战性的任务。“令人兴奋和开创性的部分是多面手医学人工智能模型能够摄取不同类型的医学信息- - -例如,成像研究,实验室结果,与基因组学数据——然后执行任务,我们的指令,“Leskovec说。

“我们希望看到一个重要的医学人工智能将操作方式的改变,“持续的沼泽。“接下来,我们将有设备,而是比只是一个任务可以做一千的任务,其中一些甚至都不预期在模型开发。”

作者也包括来自哈佛大学的Oishi Banerjee和Pranav Rajpurkar Harlan Krumholz从耶鲁,Zahra Shakeri Hossein Abad从多伦多大学,和斯克里普斯研究所的Eric Topol转化研究所大纲GMAI如何处理各种各样的应用程序与病人聊天机器人,笔记,为医生临床决策支持。

在radiology department,作者提出,模型可以放射学报告草案视觉指出异常,同时考虑到病人的历史。放射科医生可能会提高他们的理解的情况下聊天GMAI模型:“你能突出任何新的多发性硬化病变没有出现在前面的形象?”

在他们的论文中,科学家描述了额外的需求和功能,需要开发GMAI变成一个值得信赖的技术。他们指出,该模型必须使用所有的个人医疗数据,以及历史的医学知识,和引用它只有当与授权用户交互。然后,它需要能够与病人交谈,就像分诊护士或者医生收集新的证据和数据或显示不同的治疗方案。

对未来发展

他们的研究论文的合著者地址模型的影响能力1000医疗作业与学习更多的潜力。“我们认为通才模型在医学的最大问题是验证。我们怎么知道模型的实现不仅使事情了?”Leskovec said.

他们指出这个缺陷已经被抓住ChatGPT语言模型。同样,AI-generated教皇身穿的形象设计师蓬松的外套很有趣。“但是如果有高风险的场景和AI系统决定生死,验证变得非常重要,”摩尔人说。

作者继续维护隐私也是必需的。”这是一个巨大的问题,因为模型ChatGPT和GPT-4等网络社区已经确定方法来破解当前保障到位,“沼泽说。

“解密数据和社会偏见之间的GMAI也是一个大挑战,“Leskovec补充道。GMAI模型需要能够专注于为一个给定的信号因果疾病和忽略杂散信号,只有往往与结果。假设模型大小只会变大,沼泽指出早期的研究表明更倾向于表现出更大的模型社会的偏见比小模型。“这是业主和开发商的责任这样的模型和供应商,特别是如果他们部署在医院,真正确保确定并解决这些偏见在早期,“沼泽说。

“目前的技术是很有前途,但仍然有很多缺失,“Leskovec同意了。“问题是,我们能确定当前缺失的部分,如验证的事实,理解的偏见,和explainability /理由的答案,这样我们给一个议程社区如何取得进展充分意识到潜在的GMAI深刻吗?”

更多信息:迈克尔•沼泽等基础模型多面手医学人工智能,自然(2023)。DOI: 10.1038 / s41586 - 023 - 05881 - 4